【2026.4月版】生成AIニュースレポート

- このページは明るい背景での閲覧を推奨します。(ライトモード / ダークモードの切り替え:

cmd/ctrl+shift+L) - ツールの仕様変更などにより、計画していた業務を実施できない場合がございます。ご了承ください。

生成AIニュースレポートとは

生成AIニュースレポートは、研修を受講された皆様に最新の生成AI情報をお届けするために作成されました。

毎月末に、生成AI業界で注目された情報をわかりやすくまとめ、皆様の日々の業務に役立てていただける内容を提供いたします。

ぜひ、最新情報をチェックして、生成AIの活用をさらに深めてください。

🌱 はじめに|2026年4月は、AIが"監督なしで動く"レベルに達した月

生成AIはこれまで、「指示を出して、結果を確認して、また指示を出す」という対話の繰り返しで使うものでした。

ところが 2026年4月 は、その前提が一段階先に進みました。

- 各社のフラッグシップモデルが揃って「任せきれるAI」へと刷新

- Anthropicは「強すぎて一般公開できないAI」の存在を公表

- 国内大企業の 半数以上 が組織的な生成AI活用を開始、配置転換にまで議論が及ぶ

- 米国主要3社が、AIモデルを守るために異例の連携を開始

というように、AIに「やらせる」段階から、「任せて、待つ」段階へと現場の役割が変わりつつあります。

ビジネスリーダーにとって重要なのは、AIの能力が上がったという話ではありません。

任せられる範囲が広がるほど、「どこまで任せるか」「誰が責任を持つか」「どう監視するか」という運用設計が、企業の競争力を直接左右する局面に入ったということです。

今月は、そうした流れを象徴する5つのトピックを取り上げます。

※ 以下の項目左にある「▶」をクリックいただくと、コンテンツの閲覧が可能です。

目次

※ 以下の項目左にある「▶」をクリックいただくと、コンテンツの閲覧が可能です。

① 🤖【Anthropic】Claude Opus 4.7 リリース|「監督を減らしてAIに任せる」時代へ

公式サイトはこちら:https://www.anthropic.com/news/claude-opus-4-7

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。

🟧 概要|「自分で確認して報告する」AIの登場

Anthropicは 2026年4月16日、フラッグシップモデルの最新版 Claude Opus 4.7 を一般公開しました。

一言で言うと、「Claudeが自分の仕事を自分でチェックしてから返してくる」進化を遂げたモデルです。

具体的には、

- 長時間タスクの安定性:複雑な作業を最後まで厳密に実行し、報告前に自身の出力を検証

- 指示への忠実さ:あいまいな状況でも徹底的に問題解決し、指示通りに正確に動く

- ビジョン解像度3倍:最大2,576px(約3.75メガピクセル)の高解像度画像処理に対応

- 新エフォートレベル「xhigh」:高(high)と最大(max)の中間で推論深度を細かく調整可能

- コーディング性能:SWE-bench Pro 64.3%、SWE-bench Verified 87.6%を記録

というものです。

※「SWE-bench Pro」=AIが GitHub上の実際のソフトウェア課題をどれだけ解決できるかを測る業界ベンチマーク。本番環境に近い難易度で実力を測ります。

✅ 何が変わった?|初心者向けに「できること表」

| 新機能 | 何がうれしい?(業務の変化) |

|---|---|

| 自己検証機能 | AIが自分で出力をチェックしてから返すので、確認の手間が減る |

| 長時間タスクの安定化 | 複雑な作業を最後まで投げ出さず、人の介入を減らせる |

| ビジョン解像度3倍 | 細かい資料・スクリーンショット・図表の読み取り精度が大幅向上 |

| xhighエフォート | 重要なタスクには深く考えさせ、軽い質問はサクッと答えさせる使い分けが可能 |

| Cyber Verification Program | セキュリティ業務で正規利用する企業向けの認証制度を新設 |

👓 ここがポイント|「任せられる範囲」が一段広がった

Opus 4.7の最大のポイントは、Anthropicが公式に「監督を減らしてAIに任せられる」と踏み込んだ点です。

これまで生成AIは、「人が指示 → AIが出す → 人が確認 → 人が修正」という流れが基本でした。

Opus 4.7では、AIが自分で出力を検証し、足りない部分を補ってから返してくるため、「人が指示 → AIが計画・実行・自己検証 → 人が最終確認」という流れが現実的になっています。

たとえば、

- 経理部門で大量の請求書PDFを読み取り、整理・転記するタスクを夜間にまとめて処理

- 営業資料のスライド・グラフ・写真を一括読み込み、提案書のたたき台を生成

- 複数日にまたがるリサーチ業務を、途中経過を含めて自律的に進行

といった活用が、より少ない人の介入で動くようになります。

② 🚨【Anthropic】Project Glasswing 始動|「強すぎて一般公開できないAI」が史上初めて登場

参照元:https://www.anthropic.com/glasswing

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。

🟧 概要|「サイバー能力が高すぎる」AIモデルの誕生

Anthropicは 2026年4月7日、内部開発中の最先端モデル Claude Mythos Preview の存在と、それを使った異例のセキュリティ取り組み Project Glasswing を公表しました。

一言で言うと、「あまりに強すぎて公開できない」と判断されたAIが、史上初めて世に出た瞬間です。

具体的には、

- Mythos Previewは、主要OS・主要Webブラウザのすべてで 数千件の重大な脆弱性 を発見

- セキュリティリスクを理由に、一般公開は見送り

- AWS、Apple、Cisco、Google、JPMorgan、Linux Foundation、Microsoft、NVIDIA、Palo Alto Networks など 12のローンチパートナー+追加40組織以上 にのみ限定提供

- Anthropicは、最大 1億ドル の利用クレジットと、400万ドル のオープンソース・セキュリティ団体への寄付を表明

という、AI業界では極めて異例の対応となりました。

※「ゼロデイ脆弱性」=発見されたばかりで、まだ修正パッチが提供されていないソフトウェアの欠陥のこと。攻撃者がこれを悪用すると、防御側に対応する時間がほぼないため、最も危険な脆弱性とされる。

✅ Project Glasswingの全体像

| 項目 | 内容 |

|---|---|

| 発表日 | 2026年4月7日 |

| 中核モデル | Claude Mythos Preview(一般公開なし) |

| 提供範囲 | 12のローンチパートナー+40以上の追加組織 |

| 主な参加企業 | AWS、Apple、Broadcom、Cisco、CrowdStrike、Google、JPMorgan、Linux Foundation、Microsoft、NVIDIA、Palo Alto Networks |

| Anthropicのコミット | 最大1億ドル分の利用クレジット、400万ドルのOSS団体への寄付 |

| 目的 | 攻撃者より先に、Mythosで重要ソフトの脆弱性を発見・修正する |

👓 ここがポイント|AIの「公開していい線引き」が議論される段階へ

このニュースは、技術的にはもちろん、AIガバナンス(統治) の観点でも大きな転換点となります。

これまでは「AIモデルは性能を高めたら公開する」が業界の常識でした。しかし今回、Anthropicは「ある一定の能力を超えたAIは、無条件には世に出さない」という選択を取りました。同社は、Opus 4.7をMythosのサイバー安全対策のテスト機として位置づけており、対策の検証が進んだうえで段階的にMythosクラスのモデルを広く提供することを目標としています。

企業の担当者にとって示唆されるのは、次のような問いです。

- AIに任せる業務の中で、サイバーセキュリティに関わる範囲はどこか

- 使うAIが、どこまで安全対策を組み込んでいるか(規約違反検出機能の有無など)

- 「AIなら何でも答える」前提で運用していないか(実際は規約上拒否される領域が拡大中)

①で取り上げた Opus 4.7にも、利用規約に違反するサイバー関連リクエストを 自動検出してブロック する仕組みが導入されており、AIの「使ってよい領域」と「使ってはいけない領域」の線引きは、ユーザー側でも意識する必要が出てきています。

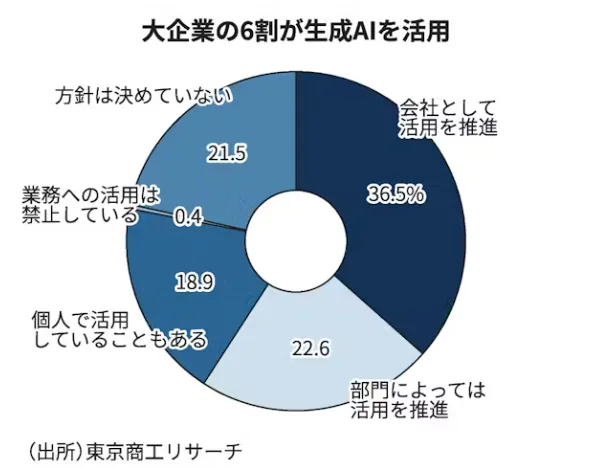

③ 🇯🇵📊【国内動向】東京商工リサーチ最新調査|AI活用企業の29%が「5年内の配置転換」を検討

参照元:https://www.nikkei.com/article/DGXZQOUC276510X20C26A4000000/

🟧 概要|「業務効率化」を超え、「組織再編」のフェーズへ

東京商工リサーチ(TSR)は 2026年4月27日、最新の「生成AIに関するアンケート調査」の結果を発表しました。

これは 6,327社 から回答を得た大規模調査で、日本企業のAI活用が新しい段階に入りつつあることを数字で示した内容となっています。

特に注目すべきは、

- AI活用企業の 29% が、5年以内に「既存業務の効率化で従業員を配置転換する可能性」を回答

- 大企業では 47% に上昇(中小企業との温度差が浮き彫りに)

- 大企業の 59% が組織的にAIを活用、2025年8月調査から 16ポイント上昇

- 5年以内のホワイトカラー早期退職募集の可能性 に「ある」と回答した企業が 4%

という、これまでの「導入が進まない」議論から一歩踏み込んだデータです。

※「配置転換」=企業が従業員の担当業務や所属部署を変更すること。AI活用で業務効率が上がった結果、空いた人員を別の業務に振り向ける動きを指します。

✅ 注目数値|半年で大企業の意識はこう変わった

| 指標 | 2025年8月調査 | 2026年4月調査 | 変化 |

|---|---|---|---|

| 大企業の組織的AI活用率 | 約43% | 約59% | ▲16pt |

| 「方針未決定」企業(全体) | 約51% | 38% | ▼13pt |

| AI活用企業の「配置転換検討」率 | (調査外) | 29% | (新指標) |

| 大企業の「配置転換検討」率 | (調査外) | 47% | (新指標) |

東京商工リサーチ情報部の本間浩介氏は、AI活用の影響は業務効率化の範囲を超え、社内体制の見直しにまで及ぶ段階に入っていると分析しています。

👓 ここがポイント|「導入の議論」から「組織設計の議論」へ

この調査が示しているのは、AI導入の議論の質が変わってきている ということです。

これまで多くの企業では、「AIを試してみる」「使ってみる人を増やす」というレベルの話が中心でした。しかし、組織的活用が大企業の 6割近く に達した今、議論の中心は次のような問いに移りつつあります。

- AIに任せた業務の分、空いた工数をどう活用するか

- 配置転換した人材が、新しい業務で価値を発揮できる教育設計はできているか

- 「AI+人」のチーム構成を、どう評価・マネジメントするか

- 採用計画は、AI前提で組み直されているか

特に重要なのは、「AIを入れた結果、人が要らなくなった」という単純な話ではなく、「AIで効率化した分の人材リソースを、企業の競争力強化にどう振り向けるか」という設計の話に変わってきていることです。

中小企業はまだ組織的活用が3割程度にとどまっており、ここに大企業との差が生まれつつあります。「導入する/しない」の議論で時間を使うほど、再配置を含む組織変革で先行する大企業との差が開いていく 局面に入ったといえます。

④ 🤖【OpenAI】GPT-5.5 リリース|1年ぶりの「フル再訓練」モデル登場

参照元:https://openai.com/index/introducing-gpt-5-5/

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。

🟧 概要|「曖昧な指示でも、最後まで仕上げてくれる」AIへ

OpenAIは 2026年4月23日、最新モデル GPT-5.5(コードネーム「Spud」)を正式リリースしました。

一言で言うと、「ふわっとした依頼を投げても、AIが計画して、ツールを使い、検証まで含めて仕上げてくれる」モデルへの大幅刷新です。

具体的には、

- GPT-4.5以来、約1年ぶりのフル再訓練モデル(ベース構造から作り直し)

- 100万トークン のコンテキストウィンドウ(OpenAI APIで初の対応)

- Terminal-Bench 2.0で82.7% という世界最高水準を記録

- SWE-Bench Pro 58.6%、SWE-Bench Verified 88.7% など実務系ベンチマークで高水準

- 同じタスクでも 出力トークンを約40%削減 する効率性

- Workspace Agents 機能を同時投入:PCを閉じてもクラウド上で動作継続

という、性能・効率・自律性を同時に引き上げた構成です。

✅ GPT-5.5の主なポイント

| 項目 | 内容 |

|---|---|

| 発表日 | 2026年4月23日(米国時間)/API公開 4月24日 |

| コンテキスト長 | 100万トークン(GPT-5.4から拡張) |

| 価格 | 入力 $5 ・出力 $30 / 100万トークン(GPT-5.4の 約2倍) |

| 同時提供モデル | GPT-5.5 Pro(上位推論版)、GPT-5.5 Thinking(推論強化版) |

| Workspace Agents | Custom GPTsを置き換え、PCオフ後もクラウドで動作継続 |

| 提供開始 | ChatGPT・Codex の Plus / Pro / Business / Enterprise プラン |

👓 ここがポイント|①Opus 4.7 と並ぶ「任せきれるAI」競争へ

GPT-5.5の登場により、4月は AnthropicとOpenAIが同じ方向性に揃った 月になりました。両社のメッセージは驚くほど似通っています。

- Anthropic:「監督を減らして、最も難しい仕事を任せられる」

- OpenAI:「曖昧な指示を投げて、計画・ツール使用・検証まで任せられる」

つまり、AIモデル業界全体が「賢さ」から「任せきれるか」へ評価軸を移している ということです。

企業の担当者にとって考えるべき問いは、次のようなものです。

- 業務のうち、計画から実行まで一括で任せたいプロセスはどれか(提案書作成、データ整理、リサーチなど)

- AIに任せたタスクの「途中経過」をどう確認するか(ログ記録、承認フローなど)

- GPT-5.5は料金が2倍に上がったが、自社の業務でその価値が出るか(コスト試算)

- Opus 4.7とGPT-5.5、どちらをどの業務で使うか(ツール選定の見直し)

特に Workspace Agentsは、Anthropicが4月に提供開始したClaude Cowork・Claude Routinesと正面から競合する 機能です。「夜間にAIが作業 → 翌朝には完成している」という働き方が、企業のスタンダードになる流れが見えてきました。

⑤ 🤝【業界連携】OpenAI・Anthropic・Google が異例の連携|AIモデル"不正コピー対策"で初の共同行動

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。

🟧 概要|競合3社が「AIを守る」ために手を組んだ

Bloombergは 2026年4月6日、米AI主要3社 OpenAI・Anthropic・Google が、Frontier Model Forum(FMF)を通じて、AIモデルの不正コピー(敵対的蒸留:adversarial distillation)対策で情報共有を始めたと報じました。

一言で言うと、「ふだんはバチバチに競合する3社が、AIを守るためだけに手を組んだ」異例の動きです。

具体的には、

- Anthropicが単独で記録した不正アクセス:約 1,600万件 の不審な対話、約 24,000件 の偽アカウント

- 名指しされた中国企業:DeepSeek、Moonshot AI、MiniMax(うちMiniMax単独で約1,300万件)

- 連携の中核機関:2023年に4社(OpenAI・Anthropic・Google・Microsoft)が共同設立した Frontier Model Forum

- これまでは安全研究中心だったFMFが、初めて運営レベルの脅威情報共有 に踏み込む

※「敵対的蒸留」=あるAIモデルに大量の質問を送り、その回答を学習データとして使って自社の安いモデルを作る手法。例えるなら、「他社の優秀な社員に毎日無料で教えを乞いながら、自社の社員を育てる」ようなやり方。利用規約違反だが、法的にはまだ整備されていない領域。

✅ 連携の構造|「サイバー業界に倣う仕組み」

| 項目 | 内容 |

|---|---|

| 発表日 | 2026年4月6〜7日 |

| 連携組織 | Frontier Model Forum(OpenAI・Anthropic・Google・Microsoftが2023年共同設立) |

| 共有モデル | サイバーセキュリティ業界の脅威インテリジェンス共有方式を踏襲 |

| 名指し対象 | DeepSeek、Moonshot AI、MiniMax(中国系AIラボ3社) |

| 関連法案 | 米下院で「Stop AI Model Theft Act」(蒸留を産業スパイと位置づける法案)が提出 |

👓 ここがポイント|AIが「国家戦略物資」へと位置づけが変わった

このニュースが示しているのは、AI技術が「商品」から「国家インフラ」へと位置づけが変わりつつある ことです。

通常、米AI主要3社は、人材・計算資源・ベンチマーク・政府契約・価格、すべての領域で激しく競い合っています。その3社が共同で動くというのは、業界として「個社の対応では守りきれないレベルの問題」と認識された証左です。

企業の担当者にとっての示唆は、次のようなものです。

- 使っているAIモデルの「出どころ」を意識する必要が高まる(オープンソースか商用か、どこの国の企業か)

- モデル選定にあたっては、「セキュリティ・規制リスク」も判断軸に入る

- 規約違反検知の強化により、AIの「使い方」がより厳しく見られる方向に

- エンタープライズ契約では、データ保管場所・利用範囲がより細かく問われるようになる

特に、米国側で 「Stop AI Model Theft Act」 が議会に提出されるなど、AIモデルの不正コピーを 産業スパイ罪 として扱う動きも始まっています。今後数年で、企業のAIガバナンスは、技術選定だけでなく 地政学リスク も含む領域へと広がっていくでしょう。

‣ 🧾 さいごに|2026年4月は「AIの境界線」が引き直された月になった

今月の流れを一言でまとめるなら、AIが"監督なしで動く"レベルに達し、同時に"どこまで任せるか"の議論が始まった月 でした。

- ① Claude Opus 4.7 は、AIが自分の出力を検証してから返す「任せきれるAI」へと進化

- ② Project Glasswing / Mythos は、「強すぎて公開できないAI」という新しい線引きを業界に提示

- ③ 東京商工リサーチ調査 は、国内大企業がAIを「業務効率化」から「組織再編」へと活用段階を進めていることを示した

- ④ GPT-5.5 は、Opus 4.7と並んで「曖昧な指示でも仕上げてくれる」エージェント志向を加速

- ⑤ 米3社の異例連携 は、AIが「商品」から「国家戦略物資」へ位置づけを変える瞬間を象徴

今月以降のAI活用で差がつくのは、最新モデルをいち早く試した企業ではなく、任せる範囲・確認の仕組み・組織の再設計をセットで考えられた企業です。

「AIに何ができるか」の情報収集を続けながら、「社内でどう任せ、どう見守り、どう育てるか」の運用設計を並行して進めることが、2026年後半の生成AI活用の主戦場になっています。

AI Laboからのご案内

生成AIを「試す」から「実務に活かす」へ。

AI Laboは現場目線の伴走支援で、業務効率を向上させる 実践的なAI活用 をご提案します。

- 業務に最適な生成AIツール選定のアドバイス(資料生成AI・GPTs等)

- 部門特化型のプロンプト作成

- 社内でのプロンプト共有環境の設計支援

- ChatGPT以外のAIツール(Copilot・Geminiなど)の活用方法のご紹介

まずは「自社の場合は何が最適か?」といったご相談からでも構いません。

お気軽にお声がけください。🙇

公式サイトはこちら:https://openai.com/ja-JP/index/introducing-gpt-5-4/

参照元:https://renovateqr.com/blog/ai-model-releases-2026

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。

参照元:https://www.sei-san-sei.com/blog/blog-0218.html

※本サイトは海外のウェブサイトであるため、英語で表示されております。お手数ですが、翻訳ツールをご利用の上、ご覧ください。